100 milliards de dollars. C'est la taille estimée du marché de l'IA générative en 2026, dont une part croissante revient à la vidéo. Aujourd'hui, 80 % du trafic web est constitué de contenu vidéo. TikTok, YouTube Shorts, Instagram Reels, LinkedIn Video : les plateformes réclament du contenu en mouvement, et les équipes marketing peinent à suivre le rythme.

La promesse des générateurs vidéo IA ? Transformer une ligne de texte en séquence cinématographique. Sauf que le marché s'est fragmenté. D'un côté, les géants américains (OpenAI, Google, Runway). De l'autre, les challengers asiatiques (Kling, Hailuo, Wan). Et entre les deux, une couche d'outils spécialisés (HeyGen, Arcads, Submagic) qui ne cherchent pas à réinventer le cinéma, mais à automatiser le marketing.

Ce guide n'est pas une liste de fonctionnalités. C'est une grille de lecture stratégique pour identifier l'outil qui correspond à votre réalité : budget, cas d'usage, plateforme de diffusion, niveau de contrôle attendu.

Ce qui a changé entre 2024 et 2026

En 2024, générer une vidéo par IA relevait de l'expérimentation. Les clips duraient 4 secondes, les visages se déformaient d'une image à l'autre, et la physique des objets semblait sortie d'un rêve fiévreux (on se rappelle de la première vidéo IA ayant buzzé, qui mettait en scène Will Smith mangeant des spaghetti). Les équipes créatives testaient, s'amusaient, mais ne livraient pas à leurs clients.

2025 marque le passage à la production industrielle. Les modèles actuels ne "devinent" plus les pixels : ils simulent des interactions tridimensionnelles. On parle désormais de General World Models, des simulateurs capables de comprendre la gravité, la lumière, les textures, la causalité. La cohérence temporelle (un personnage qui reste identique d'un plan à l'autre) n'est plus un luxe réservé aux démos marketing. Les mouvements de caméra complexes (travelling, zoom optique, panoramique à 360°) sont gérés nativement par les modèles.

Les chiffres traduisent cette maturité. Le coût par minute de vidéo générée a chuté de 65% entre 2024 et 2025. Les temps de génération sont passés de plusieurs heures à quelques minutes. Et la résolution maximale a bondi : 4K natif chez Google Veo, 1080p stable chez Kling, upscale 4K chez Runway.

Cette accélération a engendré une fragmentation du marché. Trois catégories d'acteurs coexistent désormais :

- Les modèles "fondation" (Runway, Sora, Kling, Veo) visent le photoréalisme et le contrôle cinématographique. Leur cible : les réalisateurs, les studios VFX, les agences de publicité premium. Leur promesse : rivaliser avec les moteurs de rendu 3D traditionnels, mais en quelques minutes au lieu de plusieurs heures.

- Les outils "viralité" (Luma, Pika, Hailuo) privilégient la vitesse et l'effet "wow" pour les réseaux sociaux. Leur cible : les créateurs TikTok, les community managers, les équipes social media. Leur promesse : générer un clip accrocheur en moins de deux minutes, prêt à poster.

- Les solutions "business" (HeyGen, Arcads, Submagic) n'ont aucune ambition artistique. Elles automatisent des tâches répétitives : doublage multilingue, génération d'avatars corporate, montage de Shorts à partir de contenus longs. Leur cible : les équipes marketing, RH, L&D. Leur promesse : diviser par dix le coût et le temps de production.

Le défi, ce n'est déjà plus la technique : c'est de trouver le bon outil pour son usage, son budget, sa plateforme de diffusion.

Les générateurs "cinématiques" : créer des vidéos ex nihilo

Ces outils génèrent des pixels à partir de texte (text-to-video) ou d'image (image-to-video). Leur cible : les créatifs, les agences de publicité, les studios de pré-visualisation, les artistes numériques.

Runway Gen-4 : le studio de post-production complet

Runway n'est pas un simple générateur. C'est une suite de post-production qui intègre l'IA générative au cœur du montage. L'entreprise new-yorkaise a fait du contrôle créatif sa marque de fabrique.

Le Motion Brush permet de "peindre" des zones spécifiques d'une image (les nuages, l'eau, un drapeau) et de leur assigner des vecteurs de mouvement indépendants. Le reste de la scène reste statique. Pour un réalisateur qui veut diriger l'attention du spectateur, c'est un levier puissant.

Le mode Camera Control simule des mouvements de caméra avec précision mathématique : panoramique, inclinaison, zoom, travelling. On peut même définir une focale pour reproduire le rendu d'une lentille spécifique. Le résultat a un cachet cinématographique distinct, loin du "tout bouge dans tous les sens" des modèles bas de gamme.

Côté prix, Runway a structuré son offre pour séparer les curieux des professionnels. Le plan Standard (~15$/mois) offre 125 crédits, de quoi générer environ 25 secondes de vidéo. Insuffisant pour une production sérieuse. Le plan Unlimited (~95$/mois) change la donne : il inclut un mode "Relax" qui permet de lancer des générations illimitées (avec une file d'attente plus lente). Pour une agence qui teste des dizaines de variations par semaine, le coût unitaire tombe à quelques centimes.

- Pour qui ? Monteurs, artistes VFX, agences créatives qui doivent répondre à des briefs précis.

- Plateformes cibles : YouTube, Vimeo, publicités TV et streaming (Netflix, Amazon Prime).

Sora 2 : la promesse du photoréalisme

OpenAI positionne Sora non pas comme un outil vidéo, mais comme un "simulateur de monde". L'ambition : comprendre la physique newtonienne pour générer des interactions réalistes.

Sora excelle dans la gestion des fluides et des particules. Une vague qui s'écrase sur une falaise, de la fumée qui se disperse dans une pièce : le modèle produit des simulations dignes des FLIP solvers utilisés en effets spéciaux, mais générées en quelques minutes. Il peut aussi maintenir une cohérence sur des durées longues (jusqu'à une minute), permettant des plans-séquences qui traversent plusieurs environnements.

Autre atout : l'audio natif. Sora génère une ambiance sonore synchronisée avec l'action (bruit de pas, vent, fond urbain), ce qui ajoute une couche d'immersion immédiate.

Le problème ? L'accessibilité. Sora reste intégré aux abonnements ChatGPT Plus (20$/mois) et Pro (200$/mois), avec des quotas dynamiques basés sur la charge serveur. Pour une entreprise qui a besoin de livrables garantis demain matin, cette imprévisibilité est un frein. En Europe, le déploiement a été retardé par les incertitudes autour de l'AI Act et des droits d'auteur sur les données d'entraînement.

- Pour qui ? Prototypage haut de gamme, concept art, expérimentation créative.

- Plateformes cibles : cinéma, plateformes de streaming premium.

Kling AI : le maître du mouvement humain

Kling, développé par le géant chinois Kuaishou, a fait irruption sur le marché international comme un "Sora-killer" crédible. Sa force : la compréhension de la kinétique humaine.

Là où d'autres modèles produisent des personnages qui "glissent" ou "flottent", Kling génère des mouvements organiques. Danse, arts martiaux, course : les pieds touchent le sol, les articulations se plient naturellement, le poids du corps se transfère de manière crédible. Pour les créateurs de clips musicaux ou de scènes d'action, c'est souvent le modèle de référence.

Kling permet aussi de générer des clips plus longs que la moyenne : 5 à 10 secondes en base, extensibles jusqu'à 2-3 minutes grâce à des outils de prolongation qui maintiennent la cohérence narrative. Le lip-sync intégré (version 2.1) permet de faire parler des personnages avec un rendu crédible.

Côté prix, Kling reste compétitif : environ 0.10 à 0.15$ par génération standard. L'interface est fonctionnelle mais moins polie que celle de Runway. Et pour une entreprise européenne, la question de la souveraineté des données se pose : les serveurs sont en Chine, et les conditions d'utilisation mentionnent le traitement des données à des fins marketing.

- Pour qui ? Créateurs TikTok et Reels, clips musicaux, scènes d'action.

- Plateformes cibles : TikTok, Instagram Reels, YouTube Shorts, Snapchat Spotlight.

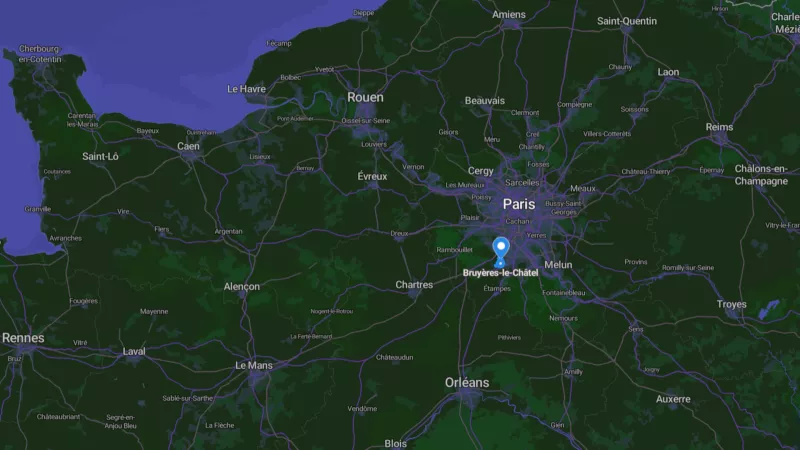

Google Veo 3 : l'intégration entreprise

Veo n'est pas seulement un modèle. C'est une brique de l'empire Google, intégrée à Gemini, YouTube et Workspace.

La qualité est au rendez-vous : génération en 4K, audio natif, compréhension sémantique fine des prompts (héritée de l'expertise Google en NLP). Deux variantes coexistent : Veo 3.1 (qualité cinéma) et Veo 3.1 Fast (optimisé pour l'itération rapide).

L'atout majeur de Veo, c'est la friction minimale pour les entreprises déjà dans l'écosystème Google. L'accès passe par Gemini Advanced ou Ultra (~20-250$/mois), la facturation est consolidée, la gestion des accès s'intègre au SSO existant. L'infrastructure mondiale de Google garantit une disponibilité et une latence minimales, y compris en Europe.

Veo est moins "artistique" que Runway, moins "nerveux" que Kling. Mais pour une DSI qui doit valider un outil, les garanties Google Cloud (conformité RGPD, certifications) font la différence.

- Pour qui ? Grands groupes, équipes corporate, départements formation.

- Plateformes cibles : YouTube, Google Ads, formations internes, LMS.

Les "speedsters" : vitesse et viralité

Ces outils ne visent pas le cinéma. Ils visent le scroll. L'objectif : capter l'attention en moins d'une seconde sur TikTok, Instagram ou LinkedIn.

Luma Dream Machine : le plus rapide

Luma Labs s'est positionné sur la vitesse. Son modèle Ray 3 génère des clips de 5 secondes en haute qualité en moins de deux minutes.

Les effets de caméra sont dynamiques : zooms rapides, rotations, passages à travers des objets. Idéal pour les transitions TikTok ou les intros YouTube. Luma excelle aussi dans les loops parfaits : des vidéos qui bouclent sans coupure visible, parfaites pour les arrière-plans de sites web ou les écrans d'attente.

Le modèle Freemium est attractif. Les plans payants (Lite ~10$, Plus ~30$, Unlimited ~99$) restent accessibles pour les indépendants. Le mode Unlimited offre, comme Runway, des générations illimitées en file lente.

La limite ? Luma "hallucine" plus vite que ses concurrents sur les scènes complexes. Des distorsions étranges apparaissent, parfois artistiques, parfois rédhibitoires pour un rendu réaliste.

- Pour qui ? Créateurs de contenu social, community managers.

- Plateformes cibles : TikTok, Instagram Reels, LinkedIn Video, Snapchat.

Pika Art 2.0 et Hailuo : l'animation stylisée

Pika a fait un choix stratégique : renoncer à la course au photoréalisme pour embrasser l'animation et le style.

Sa fonctionnalité phare, Pikaeffects, permet d'appliquer des effets physiques ludiques à des objets : faire fondre un gâteau, exploser une voiture, écraser un logo comme de la pâte à modeler. C'est un outil marketing puissant pour créer des visuels accrocheurs (thumbnails animés, pubs produits décalées).

Hailuo (propulsé par MiniMax) occupe une niche similaire : des vidéos courtes (6 secondes) mais d'une richesse visuelle surprenante, notamment pour les styles anime et fantastiques. La qualité de texture (peau, tissus) est souvent jugée supérieure à Luma.

La limite commune : la durée. Ces outils génèrent des "plans de coupe" (B-roll), pas des séquences narratives.

- Pour qui ? Créateurs visuels, designers, équipes social media.

- Plateformes cibles : Pinterest Video, Snapchat, thumbnails YouTube.

Les spécialistes du marketing et de l'automatisation

Ici, l'objectif n'est pas l'art. C'est la performance business. Ces outils automatisent la présence humaine à l'écran.

HeyGen : traduction et avatars corporate

HeyGen domine le marché des avatars professionnels. Sa fonctionnalité Video Translate 4.0 est bluffante : elle traduit non seulement la voix, mais modifie le mouvement des lèvres de l'orateur original pour qu'il semble parler couramment japonais, espagnol ou allemand. 175 langues et dialectes sont supportés.

Pour les équipes L&D (Learning & Development), les Expressive Avatars transmettent des émotions (empathie, sérieux) adaptées au contenu du script. Les vidéos de formation deviennent moins robotiques.

HeyGen rassure les DSI : certifications SOC 2 et ISO, intégration aux LMS (Moodle, 360Learning), API pour les workflows automatisés. Le prix reste accessible : Creator à 29$/mois, Business à 39$/mois par siège.

- Pour qui ? Marketing global, RH, équipes formation, communication interne.

- Plateformes cibles : LMS, Loom, LinkedIn Video, intranets.

Arcads : l'UGC à l'échelle

Arcads résout un problème précis : le coût et la complexité de gérer des créateurs UGC (User Generated Content).

Au lieu d'envoyer un produit à dix influenceurs et d'attendre deux semaines, Arcads génère des vidéos de "témoignages clients" réalistes. Des acteurs IA filmés en style selfie, façon iPhone, qui vantent un produit avec un naturel troublant. Le lip-sync est parmi les plus réalistes du marché.

Le modèle économique est simple : ~11$ par vidéo, 2 minutes de génération. Comparé aux 80-200$ demandés par un créateur UGC sur Fiverr (plus plusieurs jours d'attente), le ROI est immédiat. Arcads a levé 16 millions de dollars en décembre 2025 (Sequoia, Eurazeo), signe que le marché valide l'approche.

La limite : Arcads génère le "talking head", pas le montage final. Il faut passer par CapCut ou Premiere pour ajouter les sous-titres, le B-roll produit, les transitions.

- Pour qui ? E-commerce, dropshipping, marques D2C, agences performance.

- Plateformes cibles : Meta Ads, TikTok Ads, Snapchat Ads, Google Ads.

Submagic : le montage viral automatisé

Submagic ne génère pas de vidéo. Il transforme du contenu long en Shorts.

L'outil analyse un podcast ou une interview, identifie les moments forts grâce à l'analyse sémantique, et génère automatiquement des clips verticaux avec sous-titres animés colorés, emojis et zooms dynamiques. Le format est calibré pour retenir l'attention sur les premières secondes.

Pour un community manager qui doit alimenter trois plateformes par jour, c'est un gain de temps considérable. Le prix reste accessible : ~15-30€/mois.

- Pour qui ? Influenceurs, community managers, équipes contenu.

- Plateformes cibles : YouTube Shorts, TikTok, Instagram Reels, LinkedIn Video.

L'open source : Wan 2.1 et la souveraineté technique

Pour les développeurs, les studios techniques et les entreprises soucieuses de contrôle, l'open source offre une alternative crédible aux API tierces.

Wan 2.1, développé par Alibaba et publié sous licence Apache 2.0 en février 2025, a secoué le marché. Le modèle atteint un score de 84.7% sur VBench (le benchmark de référence), rivalisant avec Sora sur plusieurs métriques. Il a été entraîné sur 1.5 milliard de vidéos et 10 milliards d'images.

L'intérêt ? L'auto-hébergement. La version 1.3B (14 milliards de paramètres pour la qualité, 1.3 milliard pour la vitesse) tourne sur une RTX 4090 avec ~8 Go de VRAM. Une vidéo de 5 secondes en 480p se génère en 4 minutes. Aucune donnée ne part sur un serveur tiers.

Wan 2.1 est intégré dans des plateformes comme Monica.im ou peut être installé localement via ComfyUI. Pour une entreprise qui traite des données sensibles (propriété intellectuelle, visages de dirigeants), c'est la garantie d'une confidentialité totale.

L'impact stratégique est plus large : en offrant une "qualité suffisante" gratuitement (hors coût matériel), Wan force les acteurs payants à innover sur la valeur ajoutée, pas sur l'accès.

- Pour qui ? Développeurs, studios techniques, entreprises avec contraintes de confidentialité.

- Plateformes cibles : toutes (pas de restrictions contractuelles).

Tableau comparatif : trouver l'outil en un coup d'œil

Générateurs cinématiques (text-to-video, image-to-video)

| Critère | Runway Gen-4 | Kling AI | Sora 2 | Luma Dream Machine | Google Veo 3 |

|---|---|---|---|---|---|

| Philosophie | Contrôle créatif | Mouvement humain | Simulation physique | Vitesse | Intégration entreprise |

| Qualité max | 4K (upscale) | 1080p natif | Photoréaliste | Bonne | 4K natif |

| Durée max | ~18s (extensible) | 2-3 min | ~1 min | 5-10s | 8s+ |

| Contrôle | Excellent (Motion Brush, caméra) | Moyen | Bon (storyboard) | Basique | Bon (sémantique) |

| Prix entrée | ~15$/mois | ~10$/mois | Inclus ChatGPT Plus | Freemium | Inclus Gemini |

| Coût/seconde | ~0.25$ (standard) | ~0.10-0.15$ | Variable | ~0.20$ | ~0.15-0.75$ |

| Europe | ✅ Total | ✅ (données Chine) | ⚠️ Limité | ✅ Total | ✅ Total |

| Meilleur pour | Agences, VFX | Clips, action | Prototypage luxe | Social media | Corporate |

Outils marketing et automatisation

| Outil | Cœur de métier | Force unique | Prix moyen | Cible |

|---|---|---|---|---|

| HeyGen | Avatars + traduction | Lip-sync multilingue (175 langues) | 29-39$/mois | RH, L&D, marketing global |

| Arcads | UGC publicitaire | Acteurs IA réalistes | ~11$/vidéo | E-commerce, D2C |

| Submagic | Montage Shorts | Auto-captions + B-roll | ~15-30€/mois | Créateurs, CM |

Le vrai coût : décrypter les modèles économiques

Le piège du "coût par crédit"

La plupart des plateformes utilisent des monnaies virtuelles (crédits) pour masquer le coût réel. Un clip de 5 secondes ne coûte pas "5 crédits". Activer le mode Haute Qualité, l'Upscale ou l'Extension peut multiplier la facture par 3 ou 4.

Autre piège : l'expiration. Certains plans (Hailuo, certains forfaits Kling) font expirer les crédits non utilisés à la fin du mois. C'est une perte sèche pour les entreprises à flux tendu. Runway, sur ses plans annuels, permet une meilleure gestion.

Le ROI du plan illimité

Pour une agence ou un studio, le seuil de rentabilité bascule vite vers les plans Unlimited (Runway à ~95$, Luma à ~99$).

Le mode "Relax" est le secret de la rentabilité. Il permet de lancer des dizaines de générations le soir pour les récupérer le matin, sans consommer de crédits rapides. Le coût unitaire tombe à quelques centimes, rendant l'expérimentation viable à grande échelle.

Au-delà de 50 vidéos par mois, le calcul est simple : le plan illimité devient plus rentable que le paiement à l'usage.

Recommandations par profil

PME / e-commerçant

Outils recommandés : Arcads + Submagic

L'objectif est le quick win : des publicités qui convertissent, des posts qui engagent, sans passer trois jours en production. Le temps est la ressource la plus rare. Chaque heure passée à monter une vidéo est une heure non consacrée au produit, aux clients, à la croissance.

Arcads génère les témoignages clients IA pour les campagnes d'acquisition. Un script de 30 secondes, un avatar qui ressemble à votre persona cible, et deux minutes plus tard vous avez un contenu prêt à A/B tester sur Meta Ads. À ~11$ la vidéo, le coût est dix fois inférieur à celui d'un créateur UGC humain. Et le délai passe de plusieurs jours à quelques minutes.

Submagic transforme vos vidéos produit existantes en Shorts viraux. Vous avez filmé un unboxing, une démo, un tutoriel ? L'outil découpe automatiquement les moments forts, ajoute les sous-titres animés qui retiennent l'attention, et formate pour le vertical. Un podcast de 45 minutes devient dix clips prêts à poster.

Ne perdez pas de temps avec Sora ou Runway : trop complexes, trop lents à maîtriser pour du "vite fait, bien fait". La courbe d'apprentissage n'est pas justifiée si votre objectif est de publier trois fois par semaine sur les réseaux.

Plateformes de diffusion : Meta Ads (Facebook, Instagram), TikTok Ads, LinkedIn, boutique Shopify, Amazon Ads, Google Shopping.

Agence créative / studio

Outils recommandés : Runway Gen-4 + Kling en complément

Vous répondez à des briefs. Vos clients ont des attentes précises : une ambiance, un cadrage, un rythme. L'outil "magique" qui génère n'importe quoi à partir d'un prompt vague ne vous sert à rien. Vous avez besoin de contrôle.

Runway offre ce contrôle. Le Motion Brush permet de décider exactement ce qui bouge et ce qui reste statique dans le plan. Le Camera Control simule des mouvements de caméra professionnels : travelling latéral, push-in dramatique, panoramique lent. Vous pouvez même spécifier une focale pour reproduire le rendu d'une lentille particulière. C'est la différence entre "une vidéo générée par IA" et "un plan de cinéma généré par IA".

Kling vient en complément pour les scènes difficiles. Dès qu'un humain doit danser, courir, se battre ou simplement marcher de manière crédible, Kling surpasse Runway. Le modèle comprend la kinétique humaine : le transfert de poids, l'articulation des membres, l'ancrage des pieds au sol. Pour un clip musical ou une publicité sportive, c'est souvent la meilleure option.

Le plan Unlimited de Runway (~95$/mois) est un investissement rentabilisé dès le premier mois de production intensive. Le mode Relax permet de lancer des dizaines de variations le soir et de récupérer les résultats le matin. Le coût unitaire tombe à quelques centimes, ce qui libère l'expérimentation.

Plateformes de diffusion : YouTube (formats longs et Shorts), Vimeo, publicités TV et SVOD (Netflix, Amazon Prime, Canal+), cinéma, événementiel.

Grand groupe (banque, assurance, industrie)

Outils recommandés : Synthesia ou Google Veo 3

La qualité artistique passe au second plan. Les priorités : conformité RGPD, gestion des accès (SSO), certifications (SOC 2, ISO), intégration aux outils existants (Workspace, LMS).

Synthesia rassure les DSI avec ses Expressive Avatars pour la formation. Veo 3 s'intègre sans friction à l'écosystème Google déjà en place.

Plateformes : LMS internes (Moodle, Cornerstone), YouTube privé, Google Workspace.

Artiste / créatif indépendant

Outils recommandés : Runway + Luma + Pika (selon le style)

L'objectif n'est pas l'efficacité, mais l'expérimentation. Runway pour le contrôle cinématographique et la signature visuelle. Luma pour la vitesse d'itération et les effets dynamiques. Pika pour les animations stylisées et les effets physiques ludiques.

La combinaison dépend du projet : réalisme, abstraction, animation.

Plateformes : Vimeo, Instagram, festivals de cinéma, galeries numériques, NFT.

Créateur de contenu (TikTok, YouTube Shorts)

Outils recommandés : Kling + Submagic

Kling génère le mouvement humain crédible qui capte l'attention dans les premières secondes. Submagic automatise le reformatage : sous-titres animés, zooms, emojis, le tout calibré pour maximiser la rétention.

L'objectif est le volume : tester dix variations, publier trois fois par jour, itérer sur ce qui fonctionne.

Plateformes : TikTok, YouTube Shorts, Instagram Reels, Snapchat Spotlight.

La "stack" idéale du créateur vidéo en 2026

Les professionnels ne s'appuient pas sur un seul outil. Ils combinent plusieurs solutions pour pallier les faiblesses individuelles. Voici un workflow éprouvé :

- Script : Claude ou ChatGPT pour écrire le texte et décrire les scènes visuellement.

- Image initiale (keyframe) : Midjourney V6, Flux ou DALL-E pour créer l'image de départ. Contrôler l'esthétique sur une image fixe est plus simple que sur une vidéo.

- Animation (image-to-video) : Importer l'image dans Runway Gen-4 (pour le contrôle caméra) ou Kling (pour le mouvement complexe). L'image-to-video est plus stable que le text-to-video.

- Audio et lip-sync : HeyGen si un personnage doit parler. ElevenLabs pour la voix off et l'ambiance sonore.

- Montage et upscale : Assembler dans Premiere Pro ou DaVinci Resolve. Topaz Video AI pour nettoyer les artefacts et monter en 4K si l'outil de base était limité au 1080p.

Ce workflow demande plus d'étapes qu'un "prompt magique", mais le résultat est contrôlé, cohérent, livrable.

Orchestrer les intelligences

L'erreur serait d'attendre l'outil parfait qui fait tout. Il n'existe pas.

Sora excelle dans la physique. Runway offre le contrôle. Kling maîtrise le mouvement humain. HeyGen automatise la présence à l'écran. Chaque modèle a une spécialité, une "signature" fonctionnelle.

La stratégie gagnante consiste à orchestrer ces intelligences spécialisées. À combiner leurs forces selon le projet : le photoréalisme de Sora pour le plan d'ouverture, le Motion Brush de Runway pour diriger l'attention, le lip-sync de HeyGen pour faire parler un avatar, le montage automatisé de Submagic pour décliner en Shorts.

La technologie ne remplace pas la vision. Les outils les plus puissants nécessitent toujours un œil de réalisateur pour cadrer, rythmer, raconter. Le générateur vidéo IA est un instrument. C'est vous qui composez la partition.

Le meilleur outil n'est pas celui qui a le plus de paramètres. C'est celui qui s'intègre le plus naturellement à votre workflow, à vos contraintes, à votre ambition créative.

Données de prix et de disponibilité basées sur l'état du marché en janvier 2026. Ces informations évoluent rapidement.